KI-Regulierung: Der AI Act der EU im Überblick

Anwendungen, die auf KI basieren, durchdringen immer mehr Lebensbereiche: ob Chatbots, Bildbearbeitung oder intelligente Spamfilter. Gleichzeitig ist Künstliche Intelligenz die wohl am meisten diskutierte und umstrittenste Technologie unserer Zeit. Bisher gab es jedoch für die Entwicklung, den Einsatz und die Verbreitung von KI in der Europäischen Union keine spezifischen Rechtsgrundlagen. Mit dem EU Artificial Intelligence Act hat das EU-Parlament jetzt jedoch den weltweit ersten gesetzlichen Rahmen für den Einsatz Künstlicher Intelligenz geschaffen.

Für wen wird der AI Act wichtig?

Die KI-Verordnung der EU gilt für alle Anbieter von KI-Systemen, die in der EU zum Einsatz kommen – unabhängig davon, ob sie in der EU oder einem Drittland niedergelassen sind. Als Anbieter gelten dabei alle juristischen Personen, Behörden, Einrichtungen und sonstige Stellen, die ein KI-System entwickeln oder entwickeln lassen. Teile des AI Act gelten außerdem auch für Importeure, Händler und Nutzer die ihrer Weisung nach ein KI-System in der EU betreiben. Zudem findet die Verordnung auch für Anbieter aus Drittländern Anwendung, wenn die von ihren KI-Systemen hervorgebrachten Ergebnisse in der EU verwendet werden.

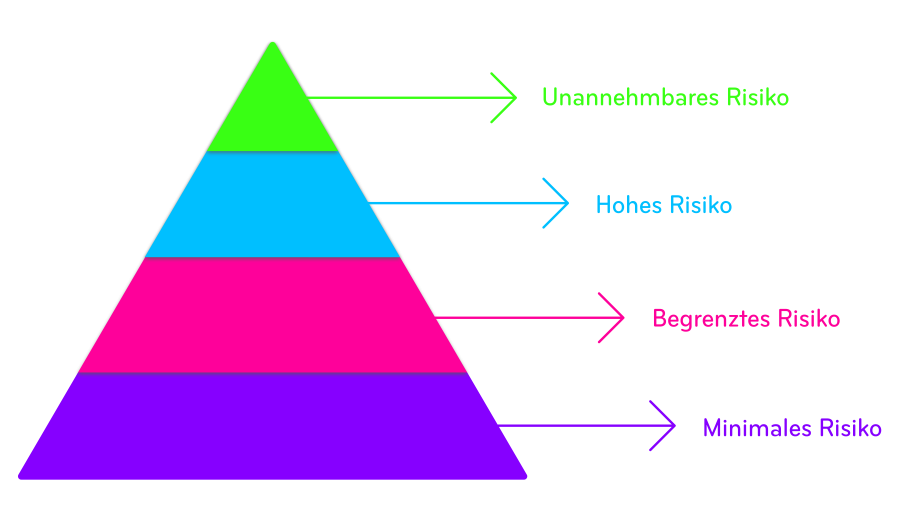

Regulierung von KI: ein risikobasierter Ansatz

Eine zentrale Säule des AI Act ist die risikobasierte Kategorisierung von Künstlicher Intelligenz, bei der KI-Systeme basierend auf ihrem potenziellen Risiko für die Gesellschaft vier verschiedenen Gruppen zugeordnet werden:

Kategorie 1: Unannehmbares Risiko

KI-Systeme dieser Kategorie sind nach dem AI Act ausdrücklich verboten. Darunter fallen unter anderem:

- Biometrische Identifizierung in Echtzeit, sofern diese nicht ausschließlich der Authentifizierung von Nutzer:innen dient und die Daten rechtmäßig erlangt wurden (zum Beispiel: Face-ID)

- Kategorisierung im Sinne eines ungerechtfertigten Social Credig Scores von Personen auf Grundlage sensibler Merkmale, wie ethnischer Herkunft, Weltanschauung, politischer Meinung oder sexueller Orientierung

- Erstellung von Gesichtserkennungsdatenbanken durch ungezieltes Auslesen von Gesichtsbildern aus dem Internet oder Videoüberwachung

- Emotionserkennung am Arbeitsplatz oder in Bildungseinrichtungen, außer es dient medizinischen oder Sicherheitszwecken

- Anwendungen, die Schwächen bestimmter Personengruppen ausnutzen, insbesondere Alter, Behinderungen oder sozioökonomischer Status, und einen Schaden bewirken, der sich auf das System zurückführen lässt.

Davon ausgenommen sind KI-Systeme im Forschungsbereich.

Kategorie 2: Hohes Risiko

Hochrisiko-KI-Systeme unterliegen zentralen Anforderungsbereichen, welche eingehalten werden müssen. Folgende Bereiche sind in dem AI Act dargestellt:

- Risikomanagement: Angemessene Systeme zu Risikobewertung und -minderung und das Einsetzen von angemessenen menschlichen Aufsichtsmaßnahmen zur Minimierung von Risiken

- Datenmanagement: Hohe Qualität der Datensätze, mit denen das System arbeitet, um Risiken und diskriminierende Ergebnisse zu minimieren

- Dokumentation: Protokollierung der Tätigkeiten, um das Verhalten des KI-Systems erklärbar zu machen

- Interaktion mit den Behörden: Ausführliche Dokumentation über das KI-System und dessen Zweck, damit Behörden die Einhaltung der Auflagen bewerten können

- Transparenz: Klare Informationen für die Anwender:innen zur Nutzung des KI-Systems

- Konformitätsbewertung: Ausreichende Robustheit, Sicherheit und Genauigkeit, die durch externe Dritte geprüft und zertifiziert wurde

- Lebenszyklusmanagement: Verfahren zur dauerhaften Überwachung des bestimmungsgemäßen Verhaltens

Um eine allgemeine Rechtskonformität mit dem AI Act und die Qualität von Hochrisiko-KI-Systemen zu gewährleisten, ist es ratsam, aktuelle internationale Standards im Auge zu halten und an die Gegebenheiten im eigenen Unternehmen anzupassen.

In die Kategorie der Hochrisiko-KI-Systeme fallen die Systeme, die ein hohes Risiko für die Sicherheit, die Grundrechte und die Freiheiten der Einzelpersonen oder der Gesellschaft als Ganzes darstellen können. Solche Systeme kommen beispielsweise in diesen Bereichen zum Einsatz:

- In der allgemeinen und beruflichen Bildung, wo über den Zugang zur Bildung und den beruflichen Werdegang eines Menschen entschieden wird

- Sicherheitskomponenten von Produkten (z. B. KI-Anwendung in der robotergestützten Chirurgie)

- Migrations-, Asyl- und Grenzkontrollmanagement (z. B. automatisierte Prüfung von Visumanträgen)

Kategorie 3: Begrenztes Risiko

Unter diese Kategorie gehören KI-Systeme, bei denen sich mögliche Risiken daraus ergeben, dass bei der Nutzung nicht offensichtlich erkennbar ist, dass es sich um ein KI-System handelt. Dafür gibt es künftig spezifische Transparenzverpflichtungen, damit Nutzer:innen bei Bedarf informiert werden können. Das betrifft beispielsweise KI-Systeme wie Chat- und Phonebots, bei denen Anwender:innen darauf hingewiesen werden müssen, dass sie mit einer Maschine kommunizieren. Außerdem müssen Anbieter solcher KI-Systeme sicherstellen, dass KI-generierte Inhalte als solche identifiziert werden können und die angewendeten technischen Lösungen dem aktuellen Standard entsprechen.

Kategorie 4: Minimales Risiko

Diese Kategorie umfasst KI-Systeme, die nur geringe Risiken für die Sicherheit und die Rechte der Einzelpersonen oder der Gesellschaft insgesamt darstellen. Beispiele hierfür könnten einfache KI-Tools wie Texterkennungsalgorithmen oder Empfehlungssysteme für Online-Shopping sein. Diese Systeme unterliegen nicht den Anforderungen des AI Act.

Die risikobasierte Kategorisierung ermöglicht es, die Regulierung von KI-Systemen an die tatsächliche Gefahr anzupassen, die von ihnen ausgehen kann. Dadurch wird versucht, unnötige bürokratische Hürden für KI-Anwendungen zu vermeiden die nur geringe Risiken aufweisen, während gleichzeitig strenge Regulierungsstandards für KI-Systeme eingeführt werden, die potenziell schwerwiegende Auswirkungen auf die Gesellschaft haben könnten.

Darüber hinaus sieht der AI Act Bestimmungen für sogenannte KI-Basismodelle vor. Damit werden Modelle bezeichnet, die auf einer großen Datengrundlage für eine Vielzahl von Anwendungsfällen trainiert werden. Dazu gehören beispielsweise Phonebots, die in unterschiedlichen Kundenlösungen Anwendung finden. Die Anforderungen an solche Modelle sind beträchtlich und setzen voraus, dass Hersteller strenge Standards hinsichtlich Erklärbarkeit und Rechtmäßigkeit der zugrunde liegenden Daten erfüllen müssen.

Wann tritt der AI Act in Kraft?

Der AI Act tritt 20 Tage nach Veröffentlichung im Amtsblatt der EU in Kraft, welche im Mai oder Juni 2024 zu erwarten ist. Zwei Jahre später ist der AI Act dann uneingeschränkt anwendbar, mit einigen Ausnahmen:

- Das Verbot von KI-Anwendungen mit unannehmbarem Risiko gilt bereits nach sechs Monaten.

- Die Vorschriften für KI-Systeme mit allgemeinem Verwendungszweck (Kategorien 3 und 4) treten nach zwölf Monaten in Kraft.

- Regel für Hochrisiko-KI-Systeme sind nach zwei Jahren anwendbar.

- Hochrisiko-Systeme, die bestimmten Harmonisierungsrechtsakten der Union unterliegen (beispielsweise Landmaschinen und Fahrzeuge), sind nach drei Jahren betroffen.

Was bedeutet der AI Act für die Mitgliedsstaaten und Unternehmen in der EU?

Für die Mitgliedsstaaten bedeutet der AI Act eine Vereinheitlichung der Regulierung von KI in der gesamten EU. Dies schafft Rechtssicherheit für Unternehmen, die in verschiedenen Mitgliedsstaaten tätig sind, und fördert den Binnenmarkt für KI-Technologien. Gleichzeitig stellt der AI Act sicher, dass die Regulierung von KI im Einklang mit europäischen Werten wie Datenschutz, Menschenrechten und Transparenz erfolgt.

Für Unternehmen in der EU bedeutet der AI Act eine Reihe neuer Verpflichtungen und Anforderungen. Insbesondere Hersteller von Hochrisiko-KI-Systemen müssen sich auf strengere Regulierung und Compliance-Verfahren einstellen. Dies kann bedeuten, dass Unternehmen mehr Ressourcen für die Konformitätsbewertung und -überwachung bereitstellen müssen. Gleichzeitig bietet der AI Act jedoch auch Chancen für Unternehmen, die auf ethische und vertrauenswürdige KI-Entwicklung setzen. Durch die Einhaltung der Anforderungen des AI Act können Unternehmen das Vertrauen der Verbraucher gewinnen und einen Wettbewerbsvorteil auf dem Markt für KI-Technologien erlangen.

Bei Missachtung des AI Acts drohen Unternehmen in der EU Strafen, die sich an deren weltweiten Jahresumsatz orientieren:

- Mindestens 35 Mio. Euro oder sieben Prozent des Vorjahresumsatzes beim Einsatz verbotener KI

- Mindestens 15 Mio. Euro oder drei Prozent des Vorjahresumsatzes, wenn Unternehmen den im AI Act beschriebenen Verpflichtungen nicht nachkommen

- Mindestens 7,5 Mio. Euro der 1,5 Prozent des Vorjahresumsatzes bei falschen Informationen über das KI-Modell

Im AI Act wird auch die Förderung von Innovationen berücksichtigt: Ein wichtiges Element ist die Möglichkeit der Einrichtung von KI-Reallaboren, die es ermöglichen, Hochrisikosysteme unter behördlicher Erlaubnis in realen Umgebungen zu testen – ähnlich wie bereits für autonome Fahrzeuge existiert.

Insgesamt markiert der AI Act einen wichtigen Meilenstein in der Regulierung von KI in der EU. Er schafft einen ausgewogenen Rahmen, der Innovation fördert und gleichzeitig sicherstellt, dass KI-Technologien im Einklang mit europäischen Werten und Normen entwickelt und eingesetzt werden. Es bleibt jedoch abzuwarten, wie der AI Act in der Praxis umgesetzt wird und welche Auswirkungen er auf die Entwicklung und den Einsatz von KI in Europa haben wird.

Rechtskonformer KI-Einsatz für Customer Care und Customer Experience

Mit der Verabschiedung des AI Act der EU wird es für Unternehmen immer wichtiger, sich aktiv mit der Entwicklung und dem Einsatz von KI auseinanderzusetzen. Von der strategischen Beratung über die Implementierung bis hin zum internen Enabling der Mitarbeiter:innen bieten wir unseren Kund:innen umfassende Unterstützung, um KI-Use Cases zu identifizieren und erfolgreich umzusetzen.

Außerdem arbeiten wir daran, die Auswirkungen des AI Act in unserem Unternehmen zu implementieren und diese Erfahrungen auf Kundenprojekte übertragen zu können. Kontaktieren Sie uns noch heute, um zu erfahren, wie wir Ihnen dabei helfen, die Potenziale von KI voll auszuschöpfen und Ihre Geschäftsziele zu erreichen.

Ben Ellermann

E-Mail: ben.ellermann@muuuh.de

Mehr über Ben Ellermann